Die Debatte über den Einsatz von KI bei der Modernisierung von COBOL-Systemen hat zuletzt deutlich an Fahrt aufgenommen. Auslöser waren Aussagen des KI-Anbieters Anthropic zu seinem System Claude. In einem Blogbeitrag argumentiert das Unternehmen, künstliche Intelligenz könne eine zentrale Hürde bei der Modernisierung von Legacy-Code überwinden: das Verständnis großer, historisch gewachsener Codebasen.

Demnach sei Legacy-Modernisierung in vielen Fällen daran gescheitert, dass das Verstehen bestehender Systeme mehr Aufwand verursache als deren Neuimplementierung. KI könne dieses Verhältnis umkehren und damit die Kostenbarriere bei der COBOL-Modernisierung durchbrechen. Die selbstbewussten Aussagen lösten in der Branche eine intensive Diskussion aus und sorgten zeitweise sogar für Unruhe rund um die Bewertung klassischer Plattformanbieter wie IBM.

Live-Test mit einem typischen COBOL-Programm

Live-Test mit einem typischen COBOL-Programm

Ein praktischer Gegencheck kommt vom Modernisierungsspezialisten Heirloom Computing. Dessen CEO Gary Crook berichtet auf LinkedIn von einem Test, mit dem er die behaupteten Fähigkeiten von Claude überprüft habe. Als Testfall habe er ein COBOL-Programm mit rund 300 Zeilen verwendet – mit grundlegenden Anweisungen wie MOVE, COMPUTE und DISPLAY. Der gesamte Testlauf wurde dokumentiert und als Video veröffentlicht; ergänzend beschreibt Heirloom die technischen Hintergründe des Experiments auch in einem Fachbeitrag auf der eigenen Website.

Im Gespräch mit dem „Legacy IT Center“ erläuterte Crook zudem weitere Hintergründe des Experiments. Das gewählte Beispiel sei bewusst relativ einfach gehalten gewesen. Ziel sei zunächst gewesen zu prüfen, wie das Modell mit typischen COBOL-Konstrukten umgehe, ohne zusätzliche Komplexität aus einer vollständigen Mainframe-Anwendung einzuführen. Bereits bei diesem einfachen Szenario hätten sich jedoch deutliche Schwächen gezeigt.

Das Ergebnis fällt laut Crook kritisch aus. Nachdem Claude den Java-Code generiert habe, sei das System aufgefordert worden, seine eigene Arbeit zu überprüfen. Dabei habe das Modell selbst eingeräumt, dass das Resultat keine verlässliche Übersetzung des ursprünglichen COBOL-Programms darstelle, sondern eher eine Annäherung an dessen Logik.

Crook vermutet zudem strukturelle Gründe für diese Schwierigkeiten. COBOL-Datentypen ließen sich nur begrenzt auf moderne Sprachen wie Java übertragen. Zudem befinde sich ein Großteil des weltweit eingesetzten COBOL-Codes in abgeschotteten Unternehmensumgebungen, sodass entsprechende Beispiele kaum Teil der Trainingsdaten großer Sprachmodelle gewesen sein dürften.

Skepsis aus der Praxis

Unter Crooks Beitrag entwickelte sich schnell eine Diskussion mit zahlreichen Kommentaren aus der Mainframe-Community. Mehrere Teilnehmer wiesen darauf hin, dass der getestete Code mit rund 300 Zeilen im Vergleich zu realen Produktionssystemen sehr klein sei. In der Praxis könnten einzelne Programme mehrere tausend Zeilen umfassen, während komplette Anwendungen häufig Hunderttausende oder sogar Millionen Codezeilen sowie komplexe Abhängigkeiten zwischen Programmen enthielten.

Andere Stimmen bekräftigten Zweifel an der Wartbarkeit des generierten Java-Codes. Aus ihrer Sicht sei der erzeugte Code kaum geeignet, um langfristig gepflegt oder an neue Geschäftsanforderungen angepasst zu werden.

Der eigentliche Aufwand liegt im Systemverständnis

Der eigentliche Aufwand liegt im Systemverständnis

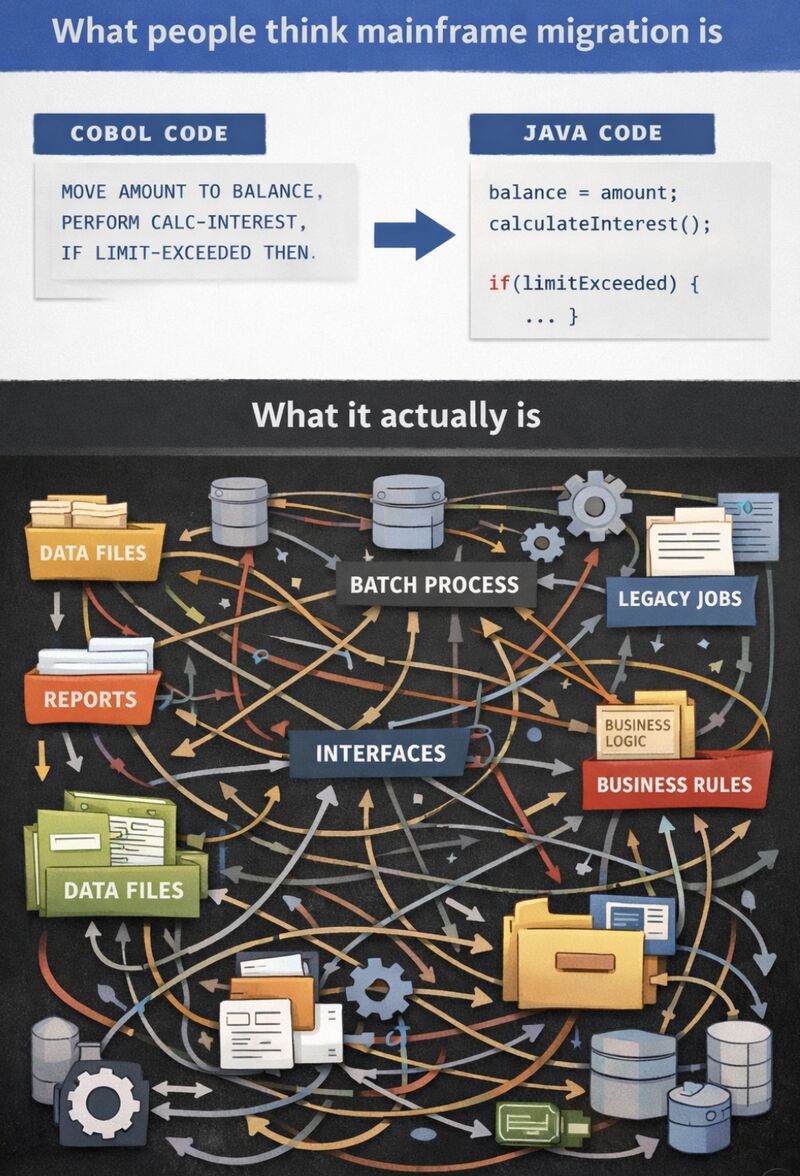

Ähnliche Einschätzungen kommen von weiteren Akteuren aus der Modernisierungspraxis. Chuck Ros, Field CTO und VP Customer Success beim IT-Dienstleister SoftServe, weist ebenfalls auf LinkedIn darauf hin, dass bei Mainframe-Migrationen die Programmiersprache selten das eigentliche Problem sei und untermauert das mit einer symbolischen Grafik (vgl. Abbildung). Der größte Teil der Arbeit bestehe vielmehr darin, jahrzehntelang gewachsene Geschäftslogik, Batch-Prozesse, Datenabhängigkeiten und Schnittstellen zu verstehen. Eine Tatsache, die „Legacy IT Center“ Kolumnist Uwe Graf jüngst schon hervorhob.

In vielen Fällen ist der Code selbst die einzige verbliebene Dokumentation eines Systems, so Ros. Mainframes enthielten daher nicht nur Software, sondern auch über Jahre gewachsenes institutionelles Wissen, das in den Anwendungen gespeichert sei. Vor diesem Hintergrund sehen viele Experten den eigentlichen Mehrwert von KI weniger in der automatischen Übersetzung von COBOL-Code, sondern eher in der Unterstützung bei der Analyse und Rekonstruktion komplexer Legacy-Systeme.

Dass eine reine Codeübersetzung den Kern des Problems verfehlt, betont auch das Beratungsunternehmen Thoughtworks. Dort wird darauf hingewiesen, dass große Sprachmodelle umfangreiche Codebasen nicht einfach vollständig erfassen könnten. In der Praxis seien zunächst zahlreiche Schritte zur Analyse, Zerlegung und Strukturierung großer Anwendungen notwendig, bevor überhaupt an eine Modernisierung gedacht werden könne.

Vor diesem Hintergrund wirkt der von Heirloom dokumentierte Praxistest für viele Beobachter wie ein erster Reality-Check für die weitreichenden Aussagen rund um Anthropics Claude und dessen Rolle bei der COBOL-Modernisierung. (td)